韓国の韓国科学技術院(KAIST)は、電気電子工学部のミョン・ヒョン教授の研究チームが、視覚情報をもとに地形を認識し、リアルタイムで歩行戦略を調整する四足歩行ロボット制御技術「ドリームワーク++」を開発したと発表した。研究は研究室発スタートアップ「ユーロボティクス(URobotics)」と共同で進められた。

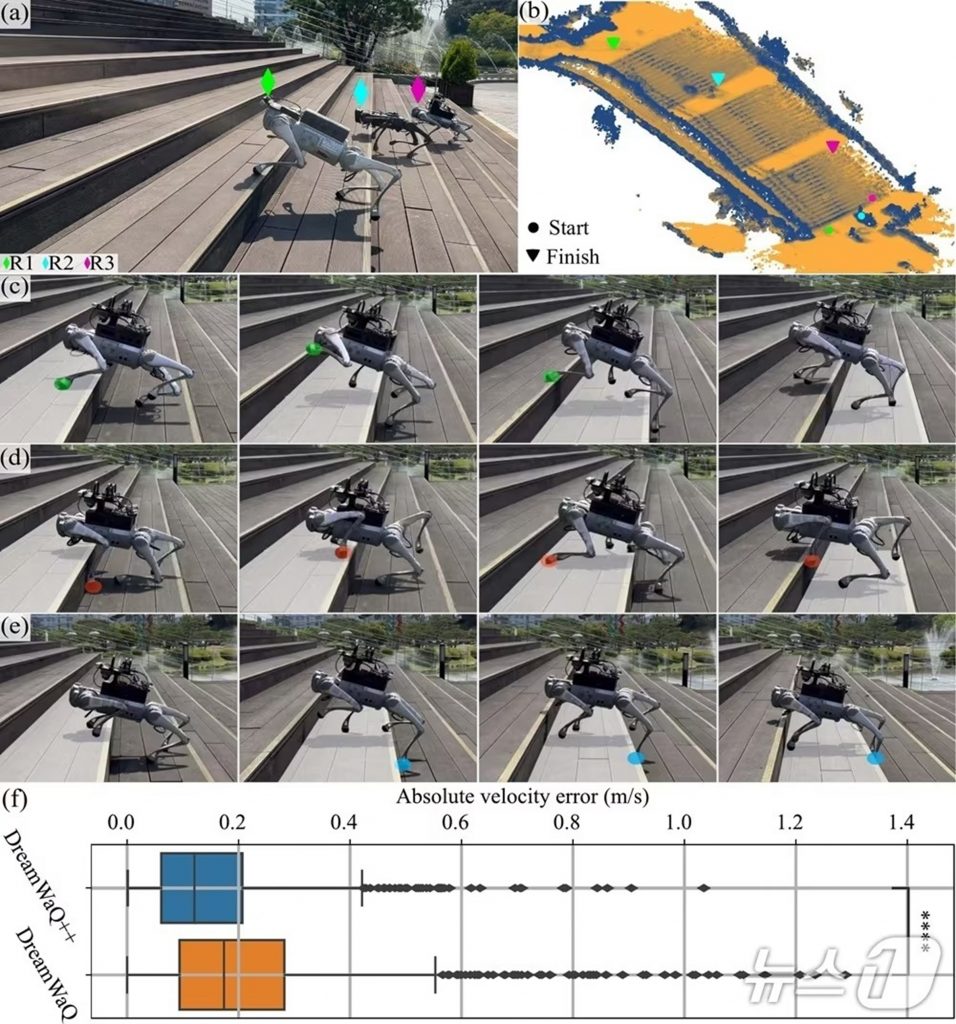

従来の「ドリームワーク」は、関節エンコーダーや慣性センサーなど内部センサーのみで地形を推定し歩行する「ブラインド歩行」技術で、視覚に頼らず安定した移動が可能だった。一方で、脚が障害物に接触して初めて動作を修正するという限界があった。

今回の「ドリームワーク++」は、カメラやLiDARなど外部センサーを組み合わせることで、障害物を事前に認識し、あらかじめ歩行を調整する「認知型歩行」を実現した点が特徴だ。

研究チームは複数の感覚を統合した強化学習構造を設計し、軽量な計算でリアルタイム制御を可能にした。さらに、特定のセンサーに異常が発生した場合でも別の感覚に基づく歩行へ自動的に切り替える仕組みを備え、安定性と拡張性を確保した。

実験では高い性能が確認された。50段の階段コースをわずか35秒で走破し、既存の制御方式を上回ったほか、最大35度の急斜面も安定して登坂した。これは訓練条件である10度の約3.5倍に相当する。

また、ロボットは状況に応じてより効率的な経路を自ら選択し、不確実な段差では一時停止して地形を探る行動も確認された。2.5キログラムの荷物を搭載した状態でも、自身の高さを超える41センチの障害物を乗り越えるなど高い機動性を示した。

さらに、チューリヒ工科大学の四足ロボット「アニマルC」やKAISTの「ハウンド」など他のプラットフォームにも適用でき、1~1.5メートル級の障害物への対応も確認された。未知の障害物に対しても約80%の成功率で克服し、環境適応能力の高さが実証された。

研究チームは、この技術が災害現場での救助活動や産業施設の点検、森林・農業分野など、従来の車輪型ロボットでは対応が難しい環境での活用につながるとみている。

ミョン・ヒョン教授は「ロボットが単に動く段階を超え、環境を理解して自ら判断する段階へ進んだことを示す成果だ。今後は実環境で活用できる知能型移動技術へ発展させたい」と語った。

(c)news1