韓国最高検察庁は昨年、韓国語に特化した「自動話者確認システム」を開発した。

録音した証拠の音声を入力すれば、どんな容疑者の声と一致するのかを自動的に比較・対照し、同一人物を探すプログラムだ。

米国で人気となったドラマ「CSI」(Crime Scene Investigation、科学捜査班)のように、犯人の指紋を入力すれば、犯罪者データベースを探して同じ指紋を自動的に検索する指紋確認システムの音声版だ。

「2016年以降、犯罪容疑者の音声を識別する研究を着実に重ねた結果だ。ボイスフィッシングなど音声関連犯罪が増え、このような技術が捜査でも重要になった」

最高検察庁関係者は、こう強調する。

◇いたちごっこ

だが、検察が苦労して開発したこの技術も、最近、韓国内外で目立つ「ディープフェイク・ボイス(人工知能を利用して作り出した偽の声)犯罪」の前ではお手上げだ。

現在の確認システムは、人工知能が作り出す偽の声までは認識できないためだ。こうした現状を受け、最高検察庁は2027年までにディープフェイク・ボイス探知技術開発に乗り出すことにした。

最高検察庁科学捜査部は、大きな枠組みの計画を立てている。「合成タイプ調査→合成音探知技術開発→音声変調探知技術開発→結果物補完・統合ソリューション開発」の順で研究を進める計画だ。

技術開発には長い時間がかかるのは必至だ。

民間でも韓国科学技術院(KAIST)をはじめ、さまざまな研究所が探知技術を開発している。ただ、数千万種類のディープフェイク・ボイスタイプに合わせてそれぞれの探知技術を開発しなければならず、開発の進捗は遅い。

特定コンピュータウイルスを探知・除去するためには、特定ワクチンを開発しなければならないように、AIプログラムで作るディープフェイクとこれを確認するAI探知技術の開発は、まさにいたちごっこだ。

◇「想像できない規模の被害」

最近のディープフェイク・ボイス技術は、数十年間音声分野に携わってきた専門家でも、真偽の区別ができないほど高度に発展した。

昨年9月に開かれた世界最大音声信号処理学会「インタースピーチ」に参加した最高検察庁のキム・ギョンファ音声分析室長は「本当の人間が話すように感情を表現し、話す人の顔の形と音声を年齢に合わせて操作することもできる水準だ」と伝えた。

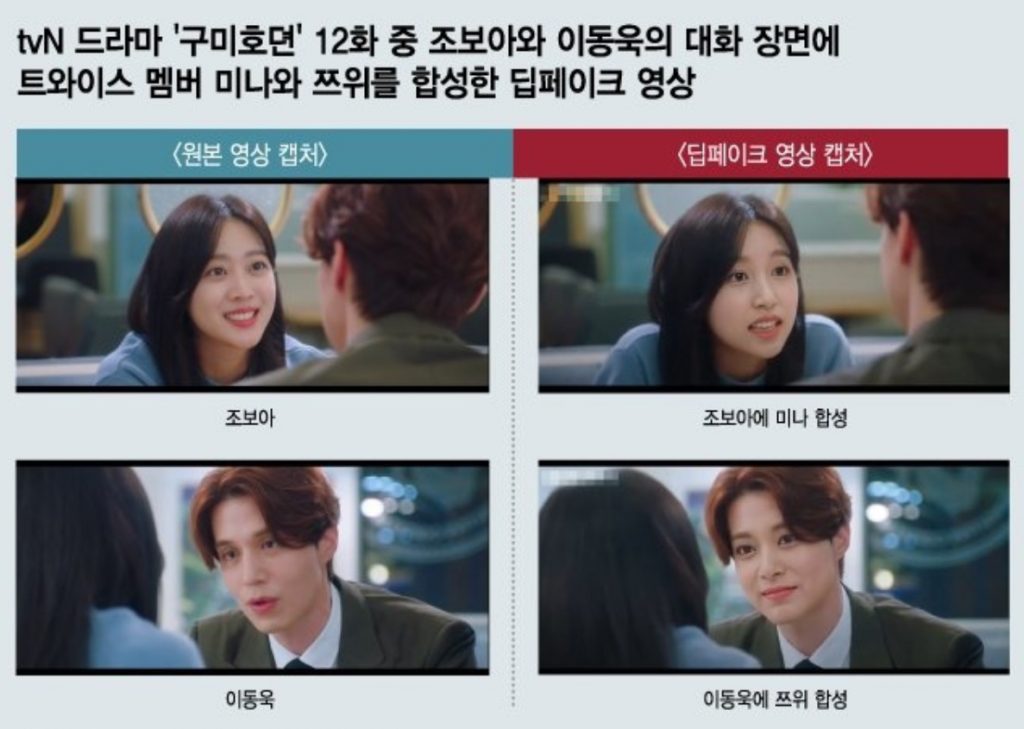

専門家の間では、ディープフェイク・ボイス技術がディープフェイク映像と合わさって悪用されると、想像できないくらいの規模の被害が出るという声も上がっている。

ただ、ディープフェイク映像を捕捉する技術開発も着実に進化している。韓国サムスンSDS社内ベンチャーチームナインと中央大学先端映像大学院のチェ・ジョンウォン教授研究チームが、身分証など人物イメージの偽造・変造可否を99.9%まで判断する探知技術を開発した。

マイクロソフトは2021年1月、世界最大の家電展示会CESで、映像の色あせ程度を分析する方式でディープフェイク映像物を選り分ける偽ニュース流布防止用技術を披露した。

ソウル市立大学コンピュータ科学部のユ・ハジン教授は「探知技術の研究は始まってから長く見ても3~4年程度なので、まだ商用化された探知技術はほとんどない状況だ」と分析している。

「人工知能技術発展により、ディープフェイク・ボイス技術もハイスピードで発展している。本気で備えなければ、今後、新たなタイプのディープフェイク・ボイス犯罪に全く対応できない状況が発生するだろう」

(つづく)

(c)MONEYTODAY